Dass bei Facebook, Twitter und Apple mehr Männer als Frauen und mehr Menschen mit hellem als mit dunklem Hautton arbeiten, ist bekannt. Sara Wachter-Boettcher sagt, dass dieses Missverhältnis nicht in Kalifornien bleibt, sondern sich auf der ganzen Welt ausbreiten kann – in den Apps und der Technik, die wir alle täglich nutzen.

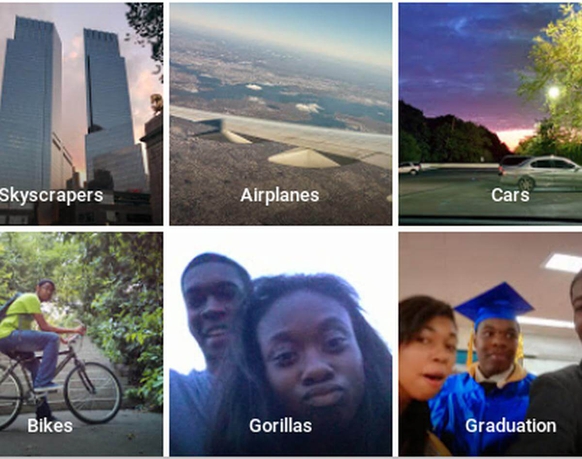

Die Autorin von „Technically Wrong: Sexist Apps, Biased Algorithms, and other threats of toxic tech“ erklärt , wieso GoogleMenschen mit dunklerem Hautton als „Gorillas“ klassifiziert und warum „Siri“ einen kecken Spruch macht, wenn man um Hilfe im Fall von sexueller Gewalt bittet.

Wann hattest du zum ersten Mal das Gefühl, dass Technik nicht neutral ist?

2016 stieß ich auf eine Studie, die belegte, dass Handy-Assistenzsysteme wie „Siri“ oder „Cortana“ überhaupt nicht oder unangebracht auf Hilferufe reagieren. Ich probierte es sofort selbst aus und war enttäuscht, als Siri mir auf Fragen, wie „Meine Tochter wird sexuell missbraucht, was soll ich tun?“ mit Unverständnis und einem witzig gemeinten Spruch antwortete.